Más del 65% de los líderes empresariales reconocen que no confían plenamente en las decisiones que brinda la inteligencia artificial cuando no pueden entender cómo funcionan. En un mundo donde los algoritmos influyen en diagnósticos médicos, aprobaciones de créditos y procesos judiciales, la falta de transparencia genera preocupación y frena la innovación. Descubre cómo la inteligencia artificial explicable aporta claridad, fortalece la confianza y allana el camino para una adopción ética y responsable en cualquier sector.

Tabla de Contenidos

- Definición y principios de la ia explicable

- Principales tipos de ia explicable en uso

- Cómo funciona la ia explicable en empresas

- Aplicaciones empresariales y casos de uso actuales

- Riesgos, limitaciones y consejos al implementar

Principales Conclusiones

| Punto | Detalles |

|---|---|

| Transparencia y Comprensibilidad | La Inteligencia Artificial Explicable (IAE) busca hacer accesibles los procesos de decisión de los algoritmos, permitiendo comprender su razonamiento. |

| Técnicas Diversas | La IAE incluye modelos interpretables, árboles de decisión y técnicas post-hoc como SHAP y LIME para facilitar la comprensión de decisiones algorítmicas. |

| Beneficios Empresariales | La implementación de IAE en empresas genera confianza y mejora la toma de decisiones al clarificar el ‘por qué’ detrás de cada recomendación. |

| Riesgos y Limitaciones | Es esencial abordar riesgos como sesgos algorítmicos y resistencia al cambio al adoptar tecnologías de IAE para asegurar su efectividad. |

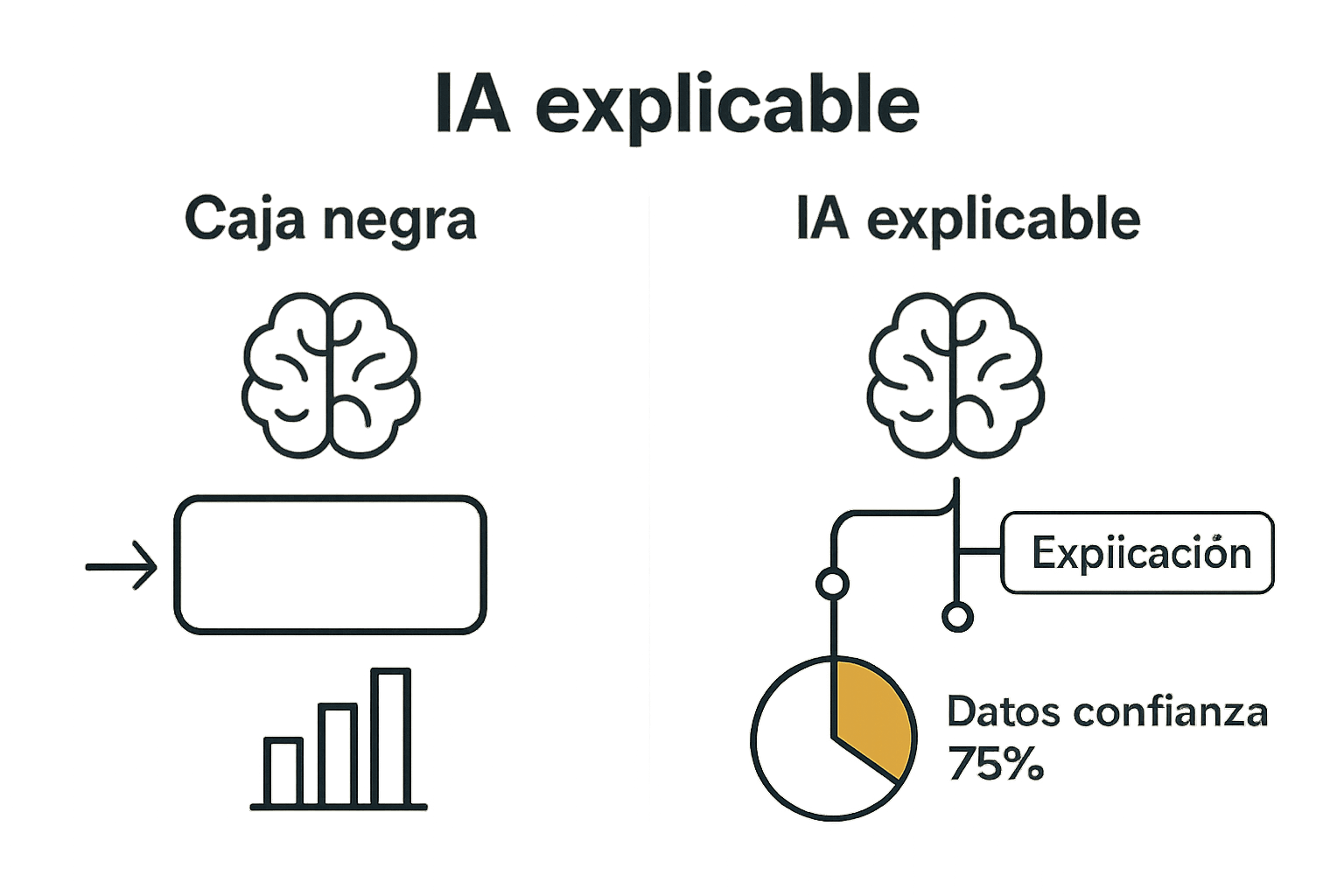

Definición y principios de la IA explicable

La Inteligencia Artificial Explicable (IAE) representa un enfoque revolucionario que busca hacer transparentes los procesos de toma de decisiones de los sistemas de inteligencia artificial. A diferencia de los modelos tradicionales que funcionan como “cajas negras”, la IAE permite comprender cómo y por qué un algoritmo llega a una conclusión específica, abriendo una ventana fundamental para entender su razonamiento interno.

Los principios centrales de la IA explicable se centran en tres aspectos fundamentales: transparencia, interpretabilidad y comprensibilidad. Estos principios garantizan que las decisiones tomadas por sistemas de inteligencia artificial puedan ser rastreadas, analizadas y justificadas de manera clara y accesible. Inteligencia Artificial: Definición, Aplicacion y Ejemplos ofrece una visión más profunda sobre estos conceptos.

Los métodos de explicabilidad en IA incluyen diversas técnicas como:

- Modelos interpretables de aprendizaje automático

- Técnicas de visualización de decisiones

- Generación de explicaciones textuales

- Identificación de características relevantes en la toma de decisiones

Cuando hablamos de IA explicable, no solo estamos describiendo una tecnología, sino estableciendo un puente de confianza entre los sistemas de inteligencia artificial y los seres humanos. La capacidad de comprender el “por qué” de una decisión algorítmica es crucial para su adopción ética y responsable en sectores como salud, finanzas, justicia y toma de decisiones empresariales.

Principales tipos de IA explicable en uso

La Inteligencia Artificial Explicable (IAE) abarca varios tipos de enfoques técnicos diseñados para revelar los procesos de toma de decisiones de los sistemas de IA. Algoritmos de IA: Todo Lo Que Debes Saber ofrece una perspectiva más amplia sobre estos métodos innovadores.

Según getguru, existen múltiples categorías de técnicas de IA explicable, destacando principalmente:

- Árboles de decisión: Modelos que presentan rutas de decisión lineales y comprensibles

- Modelos basados en reglas: Sistemas que siguen lógicas predefinidas y transparentes

- Métodos post-hoc: Técnicas como SHAP y LIME que analizan modelos de ‘caja negra’ después de su entrenamiento

Los métodos más avanzados de IA explicable se centran en descomponer la complejidad de los algoritmos, permitiendo a los profesionales y usuarios comprender los fundamentos de cada decisión algorítmica. tipos de inteligencia artificial profundiza en estas innovadoras aproximaciones tecnológicas.

La importancia de estos tipos de IA explicable radica en su capacidad para generar confianza, transparencia y responsabilidad en los sistemas de inteligencia artificial.

Al proporcionar claridad sobre los procesos de toma de decisiones, la IA explicable no solo mejora la comprensión técnica, sino que también facilita su adopción ética en sectores críticos como salud, finanzas, justicia y desarrollo empresarial.

Cómo funciona la IA explicable en empresas

La Inteligencia Artificial Explicable (IAE) se ha convertido en una herramienta estratégica fundamental para las empresas modernas que buscan transformar sus procesos de toma de decisiones. Aplicaciones Empresariales de la IA: Guía Completa ofrece una visión profunda sobre cómo estas tecnologías están revolucionando el mundo empresarial.

En el contexto empresarial, la IA explicable funciona mediante una serie de procesos metodológicos que permiten descomponer y comprender cada etapa de análisis algorítmico:

- Identificación de variables clave: Selección de factores más relevantes para la decisión

- Mapeo de rutas de decisión: Visualización clara de cómo se llega a cada conclusión

- Generación de explicaciones: Traducción de algoritmos complejos a lenguaje comprensible

- Validación de criterios: Verificación de sesgos y precisión de los modelos

Los beneficios de implementar IA explicable en entornos corporativos son significativos. Cómo analizar datos con IA para decisiones empresariales destaca que estas tecnologías permiten a las organizaciones no solo tomar decisiones más inteligentes, sino también comprender completamente el razonamiento detrás de cada predicción o recomendación.

Al integrar IA explicable, las empresas pueden mejorar la transparencia, reducir riesgos de sesgos algorítmicos y generar confianza tanto en equipos internos como en stakeholders externos. La capacidad de “desentrañar” los procesos de inteligencia artificial se convierte así en una ventaja competitiva crucial en un mundo donde la comprensión profunda de los datos marca la diferencia entre el éxito y el estancamiento empresarial.

Aplicaciones empresariales y casos de uso actuales

La Inteligencia Artificial Explicable está transformando radicalmente diversos sectores empresariales, ofreciendo soluciones innovadoras que van más allá de la simple automatización. 7 ideas de uso de IA para líderes y empresas muestra las tendencias más prometedoras en aplicaciones corporativas.

Algunos casos de uso empresarial más destacados incluyen:

- Finanzas y banca: Evaluación transparente de riesgos crediticios

- Recursos humanos: Procesos de selección más justos y objetivos

- Atención al cliente: Sistemas de soporte con explicaciones detalladas de decisiones

- Producción industrial: Mantenimiento predictivo con justificación de recomendaciones

- Salud corporativa: Diagnóstico y análisis de riesgos laborales con total transparencia

Las aplicaciones prácticas de IA explicable permiten a las organizaciones no solo obtener resultados, sino comprender profundamente los procesos de decisión. Cómo aplicar inteligencia artificial en tu empresa paso a paso ofrece una guía detallada para implementar estas tecnologías de manera efectiva.

En la práctica, la IA explicable se está convirtiendo en un diferenciador estratégico. Las empresas que adoptan estos sistemas no solo mejoran su eficiencia operativa, sino que generan mayor confianza entre empleados, clientes y stakeholders, al poder demostrar la lógica detrás de cada decisión algorítmica. La transparencia se transforma así en una ventaja competitiva real en un mundo cada vez más digitalizado.

Riesgos, limitaciones y consejos al implementar

La implementación de Inteligencia Artificial Explicable requiere un enfoque estratégico y consciente de los posibles desafíos tecnológicos y éticos. Cómo evaluar riesgos de IA en empresas ofrece una perspectiva crítica sobre los aspectos más importantes a considerar.

Según getguru, para que la IA sea verdaderamente explicable, debe cumplir principios fundamentales:

- Simplicidad: Modelos comprensibles y de fácil interpretación

- Fidelidad: Explicaciones que reflejen con precisión el comportamiento real

- Generalizabilidad: Capacidad de aplicar explicaciones en diferentes escenarios

Los principales riesgos y limitaciones a considerar incluyen:

- Potenciales sesgos algorítmicos

- Complejidad técnica de implementación

- Costos elevados de desarrollo

- Resistencia al cambio organizacional

- Requisitos de alta especialización técnica

IA Responsable: Guía Completa para Empresas recomienda implementar estrategias proactivas para mitigar estos riesgos, como establecer marcos éticos claros, realizar auditorías constantes de algoritmos y mantener un enfoque de mejora continua en los sistemas de inteligencia artificial.

Descubre cómo la Inteligencia Artificial Explicable transforma el aprendizaje y la aplicación de la IA

La principal dificultad al enfrentar sistemas complejos de inteligencia artificial es entender sus decisiones y el impacto real de sus algoritmos. Este artículo resalta la importancia de conceptos como transparencia, interpretabilidad y fidelidad para lograr que la IA sea confiable y ética. Si te preocupa cómo aplicar estas ideas clave en tu entorno o quieres profundizar en los fundamentos técnicos de la IA explicable, estás en el lugar indicado.

En AI – Bit2Brain te ayudamos a desentrañar el mundo de la inteligencia artificial con contenidos claros y accesibles que facilitan tu aprendizaje. Aprovecha ahora para explorar también nuestros recursos en Technology – Bit2Brain y comienza a dominar los principios que harán que tus proyectos sean más transparentes y responsables. No dejes que la complejidad te detenga visita https://bit2brain.com y da el siguiente paso hacia un conocimiento profundo y aplicado de la IA explicable.

Preguntas Frecuentes

¿Qué es la Inteligencia Artificial Explicable?

La Inteligencia Artificial Explicable (IAE) es un enfoque que busca hacer transparentes los procesos de toma de decisiones de los sistemas de IA, permitiendo comprender cómo y por qué un algoritmo llega a una conclusión específica.

¿Cuáles son los principios fundamentales de la IA explicable?

Los principios centrales de la IA explicable incluyen la transparencia, la interpretabilidad y la comprensibilidad, lo que garantiza que las decisiones tomadas por estos sistemas sean claras y accesibles.

¿Qué tipos de métodos se utilizan en la IA explicable?

Los métodos de IA explicable incluyen árboles de decisión, modelos basados en reglas y técnicas post-hoc como SHAP y LIME, que permiten desglosar y entender decisiones de modelos complejos.

¿Cuáles son las aplicaciones prácticas de la IA explicable en las empresas?

La IA explicable se aplica en diversos sectores, incluyendo finanzas para evaluar riesgos crediticios de manera transparente, en recursos humanos para procesos de selección más justos, y en salud para análisis de riesgos laborales con claridad.